مستقبل تقنيات التوسيع بالذكاء الاصطناعي: هل تفوقت NVIDIA DLSS على المعالجة الخام؟

لطالما كان الصراع الأزلي في عالم الألعاب يدور حول ميزان دقيق: الرسوميات مقابل الأداء. كنا دائماً نقف أمام خيارين أحلاهما مر؛ إما تفعيل إعدادات Ultra والحصول على إطارات منخفضة تجعل تجربة الـ FPS كابوساً، أو تقليل الجودة للوصول إلى 60 إطاراً مستقراً. لكن مع دخول الذكاء الاصطناعي بقوة في محركات الألعاب، تغيرت المعادلة تماماً.

كيف تعمل التقنية؟

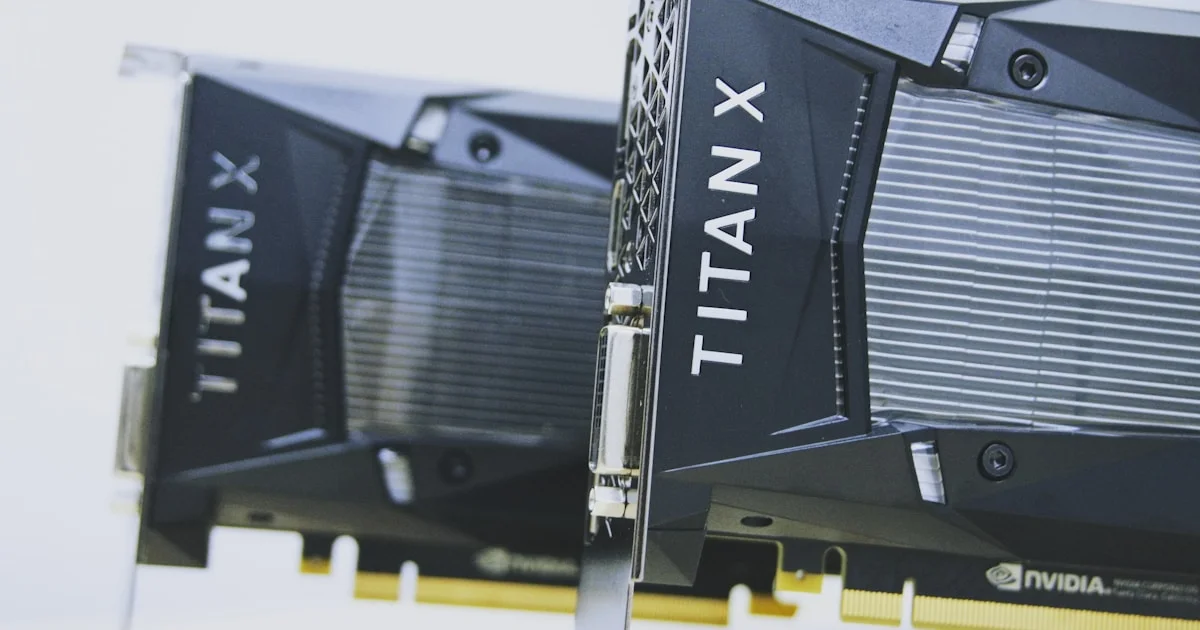

تعتمد تقنية DLSS (Deep Learning Super Sampling) من NVIDIA على شبكات عصبية مدربة مسبقاً داخل مراكز بيانات الشركة. الفكرة ليست في معالجة كل بكسل بشكل فردي بواسطة كرت الشاشة، بل في جعل الكرت يركز على معالجة المشهد بدقة منخفضة، ثم يأتي دور أنوية Tensor المخصصة داخل الكرت لإعادة بناء الصورة وتوسيعها (Upscaling) إلى دقة العرض الأصلية للشاشة مثل 4K.

تخيل أنك تلعب Cyberpunk 2077؛ بدلاً من أن يرهق الكرت نفسه بمعالجة ملايين البكسلات في كل إطار، يقوم بإنشاء إطار أساسي خفيف، ويقوم الذكاء الاصطناعي “بتخمين” وتعبئة التفاصيل المفقودة بناءً على خبرته الضخمة في مئات الألعاب. النتيجة هي صورة تبدو وكأنها معالجة بدقة عالية، لكن بأداء يتفوق بمراحل على الطريقة التقليدية.

التأثير على تجربة اللعب

الأثر الحقيقي لهذه التقنية يظهر في استقرار الـ Framerate أثناء المواقف الحرجة، خاصة في ألعاب الـ Open World المزدحمة. في السابق، كانت الانفجارات أو كثرة الشخصيات (NPCs) تؤدي إلى هبوط حاد في الإطارات، لكن مع تفعيل تقنيات التوسيع، أصبح بالإمكان الحفاظ على سلاسة الحركة حتى مع تفعيل الـ Ray Tracing، الذي كان يُعتبر سابقاً “قاتلاً للأداء”.

بالنسبة للاعب العربي الذي يهتم بتنافسية الألعاب الأونلاين، فإن هذه التقنيات قللت الفجوة بين الأجهزة متوسطة المواصفات والأجهزة الخارقة. لم تعد بحاجة لتحديث كرت الشاشة كل عامين لمواكبة متطلبات الـ Triple-A؛ فبمجرد ضغطة زر في الإعدادات، يمكنك الحصول على زيادة ملموسة في الأداء تمنحك أفضلية في الـ Clutch.

المقارنة مع البدائل

لا يتوقف العالم عند NVIDIA. لدينا FSR (FidelityFX Super Resolution) من AMD، وهو المنافس المباشر. الفرق الجوهري هنا هو أن FSR تقنية مفتوحة المصدر ولا تعتمد على أنوية مخصصة، مما يعني أنها تعمل على أغلب كروت الشاشة وحتى أجهزة الكونسول. بينما يتفوق DLSS في جودة الصورة بفضل اعتماده على الذكاء الاصطناعي الفعلي، يقدم FSR مرونة وتوافقية أعلى.

في المقابل، نجد Intel تدخل السباق بـ XeSS، وهي تقنية تحاول الجمع بين الاثنين: الاعتماد على الذكاء الاصطناعي مع الحفاظ على درجة من الانفتاح. الأرقام في اختبارات الأداء تظهر أن DLSS 3.5 لا يزال يتصدر المشهد خاصة مع ميزة Frame Generation، التي تقوم بإنشاء إطارات كاملة اصطناعية، مما يرفع الأداء أحياناً بنسبة تتجاوز 100% في بعض العناوين.

مستقبل التقنية

نحن نتجه نحو عصر لا يتم فيه تصيير (Rendering) اللعبة بالكامل من قبل المعالج الرسومي. التوجه القادم هو الذكاء الاصطناعي التوليدي الذي لن يكتفي بتوسيع الصورة، بل قد يبدأ في تحسين الإضاءة وتفاصيل الأنسجة (Textures) لحظياً. المطورون بدأوا بالفعل في تقليل الاعتماد على الـ Assets الضخمة في ملفات الـ Install، معتمدين على قدرة كرت الشاشة على تحسين الجودة أثناء الـ Runtime.

هذا يعني أن أحجام الألعاب قد تقل، بينما تزداد دقة الرسوميات. نحن نقترب من نقطة يصبح فيها الفرق بين “الدقة الأصلية” و”الدقة الناتجة عن الذكاء الاصطناعي” غير مرئي للعين البشرية، مما يفتح الباب أمام مطوري الألعاب لرفع مستوى التفاصيل في عوالمهم دون الخوف من كسر حاجز الأداء لدى اللاعبين.

هل تعتقد أن الاعتماد على هذه التقنيات هو تطور طبيعي لتجربة اللعب، أم أنك لا تزال تفضل الرسوميات الخام (Native) حتى لو اضطررت للتضحية ببعض الإطارات؟